Net voor de tweede lockdown was het nog mogelijk om een fysieke bijeenkomst van de Maker Education clubavond te organiseren. Volgens de coronaprotocollen hebben we twee ruimtes van de OBA (Oosterdok) zo kunnen inrichten dat er plek was voor twintig deelnemers. Op verschillende ‘stations’ werden de materialen voor de workshop uitgestald: haarstukken, make-up, schmink, glitters en ander knutselmateriaal. Deze materialen roepen waarschijnlijk de vraag op: wat voor workshop hebben we die avond georganiseerd?

Voor de clubavond ben ik vaak op zoek naar een relevant thema of invalshoek, die ik vervolgens koppel aan een creatieve maakopdracht. In deze periode waren er veel protesten op straat, rond de Black Lives Matter-beweging en in Hong Kong rond de bemoeienissen en wetswijzigingen van China. Omdat dit veelbesproken is geweest in de (social) media konden ook kinderen niet om deze feiten heen en werden zij hiermee geconfronteerd. Een mooie kans om hierover in gesprek te gaan.

Struinend op het internet kwam ik een filmpje tegen van een dame die haar zorgen uit sprak ten aanzien van de privacy van de demonstranten. Door de beelden op social media kon hun identiteit vaak niet verbogen blijven, wat verregaande en onvoorziene gevolgen kan hebben. Ze maakte daarom een video met schmink, glitters en make-up waarin te zien is hoe je je facial features kan verbergen zodat je niet herkenbaar in beeld hoeft te komen. Ook bracht ze een project/techniek uit 2010 naar voren genaamd CV-Dazzle waarin wordt beschreven hoe je door middel van make-up de facial recognition-software voor de gek kan houden.

Dit inspireerde mij om de workshop te beginnen met een licht oncomfortabele situatie voor de deelnemers, zodat ze meteen met het onderwerp geconfronteerd zouden worden. Mijn collega Taco maakte software met een database waarin ik foto’s van de deelnemers kon toevoegen. Door het internet af te speuren naar afbeeldingen van de deelnemers kon ik vrijwel iedereen al toevoegen aan de database, waardoor ze bij binnenkomst meteen herkend werden met voor- en achternaam door de software. Er was grote verbazing bij de deelnemers over hoe dit kon en waar ik ze (na wat uitleg over hoe het werkte) gevonden had. Vele waren er niet eens bewust van dat ze online te vinden waren, hierdoor werd het thema gelijk al heel persoonlijk.

Om een volledig programma voor de avond te verzorgen ben ik op zoek gegaan naar een leuke spreker die ook bekend is met het onderwerp facial recognition. Dit werd Iris de Vries, een oude bekende van Waag. Zij heeft onderzoek gedaan naar dit onderwerp en op basis hiervan een productlijn ontwikkeld, Protect Me genaamd. Tijdens haar presentatie sneed ze belangrijke onderwerpen aan, zoals het feit dat een hele generatie opgroeit met facial recognition-software op sociale media, en hoe dit als iets 'leuks' gepresenteerd wordt als je kijkt naar alle Snapchatfilters die er bestaan. Gezichtsherkenning wordt genormaliseerd zonder bij de consequenties stil te staan. Ook evolueert de (kwaliteit van de) technologie zo snel dat je je kunt afvragen wat er precies gemonitord wordt, wat dit doet met onze privacy en wie dit waarborgt. Gezichtsherkenning zou goed moeten zijn voor onze veiligheid, maar wat moeten we daarvoor opgeven? Hierop volgde mijn presentatie die veel raakvlakken had met de bevindingen van Iris. Zo bespraken we dat volgens een onderzoek van Georgetown-onderzoekers meer dan de helft van de gezichten van volwassen Amerikanen geregistreerd in politie databases onder het mom van veiligheid. Maar wat als 'ergens zijn' later tegen je wordt gebruikt?

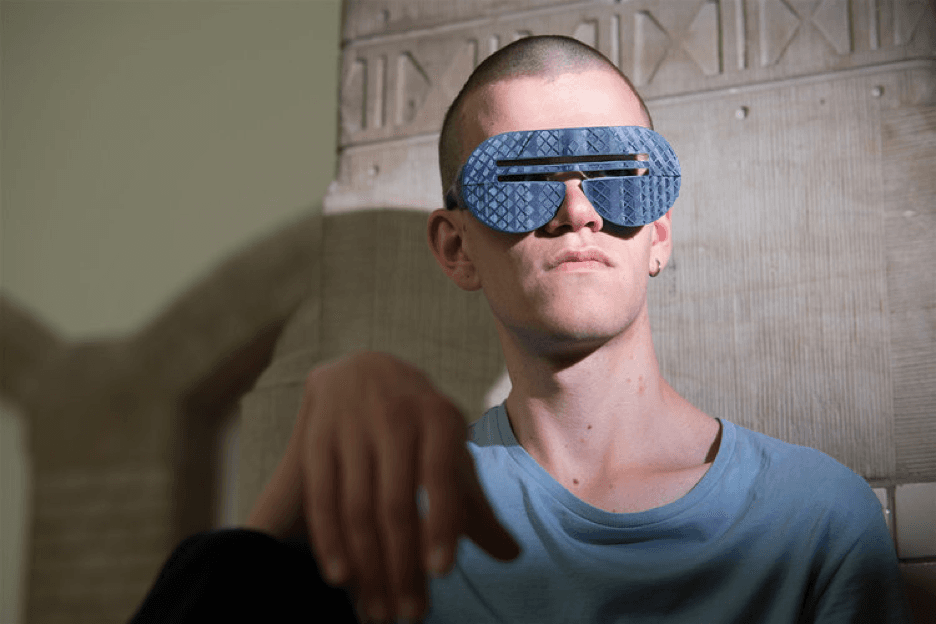

Uiteindelijk was het tijd om aan de slag te gaan! Met een paar goed belichte schminkspiegels verspreid over de ruimte kon iedereen zelf hun vermommingen beproeven, met twee camera’s die streng uitspraken of ze wel of geen gezicht in beeld zagen. Met gekleurde schmink of plakjuwelen probeerden de deelnemers hun gezicht te vermommen. Je ogen en mond zijn de belangrijkste ijkpunten, dus voeg je een derde oog toe? Of schmink je iets asymmetrisch op een van je wangen? Er bleek toch veel vermomming nodig te zijn. Als het gezicht voor onszelf al bijna niet herkenbaar meer was, was de software pas om de tuin geleid. Vooral de ‘over de top’ varianten pakten de winst deze avond; grote veren die als sluik haar voor het gezicht hingen en een voorhoofd volgeplakt met nepjuwelen en glitter. Wie zegt dat het niet fashionable kan zijn?

Het zelf aan de slag gaan en uitvinden waar die herkenning nu echt in zit, is leerzaam op verschillende manieren; je leert omgaan met de mechanismen van herkenning en het maakt je bewust in hoeveel apparaten dit soort software verborgen zit. De leraren en educators die meededen zagen hier ieder hun eigen les in. Ben je met een jongere groep leerlingen, dan kun je goed knutselen en eindeloos testen of je wel of geen gezicht kunt zien. Met een wat oudere groep kun je praten over de gevolgen en wat het betekent om wel of niet ergens herkend te worden. Zo laat Coded Bias, de documentaire van Shalini Kantayya, zien hoe software vaak alleen op een kleine witte groep mensen is ingesteld en hoe zij zelf een wit masker moeten gebruiken om de software te kunnen testen.

De effecten van dit soort software zijn belangrijk om te begrijpen en te bespreken, van de face filters op Instagram tot de gezichtsherkenning van grotere mogendheden. Af en toe moeten we onszelf die spiegel voorhouden.