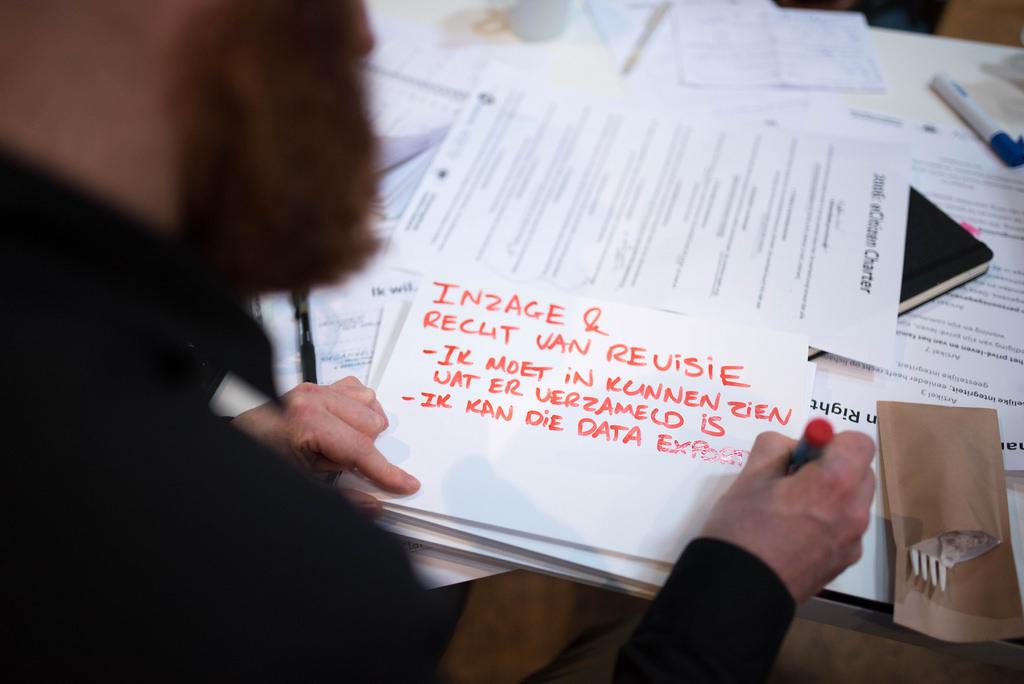

In de workshop algoritme-verantwoordelijkheid werd aan de hand van een canvas een gesprek gevoerd met belanghebbenden over impact en ethiek van de geautomatiseerde overheid. Via onderstaande knop is de publicatie over de workshop te downloaden.

Risico’s van een algoritmisch systeem zijn vaak contra-intuïtief. Omdat we in in ons dagelijks leven op een heel natuurlijke manier omgaan met onbestemde situaties, hebben we vaak niet door dat onze ruimte om vrijelijk en intuïtief beslissingen te nemen met een geautomatiseerd systeem verdwijnt. Elke richtlijn voor het ethisch gebruik van AI (kunstmatige ‘intelligentie’) waarschuwt daarom dat de context waarin technologie wordt ingezet bepaalt wat de impact van het systeem is.

Maar hoe kun je techniek en context gezamenlijk beoordelen? Met context worden natuurlijk de mensen bedoeld die in, met en om het systeem leven en werken. Maar ja, dat zijn er al snel heel veel. Bovendien: wat begrijpen die mensen nu van AI? En hoe kan verantwoordelijkheid dragen betekenisvol zijn als er eigenlijk niemand is die het geheel overziet?

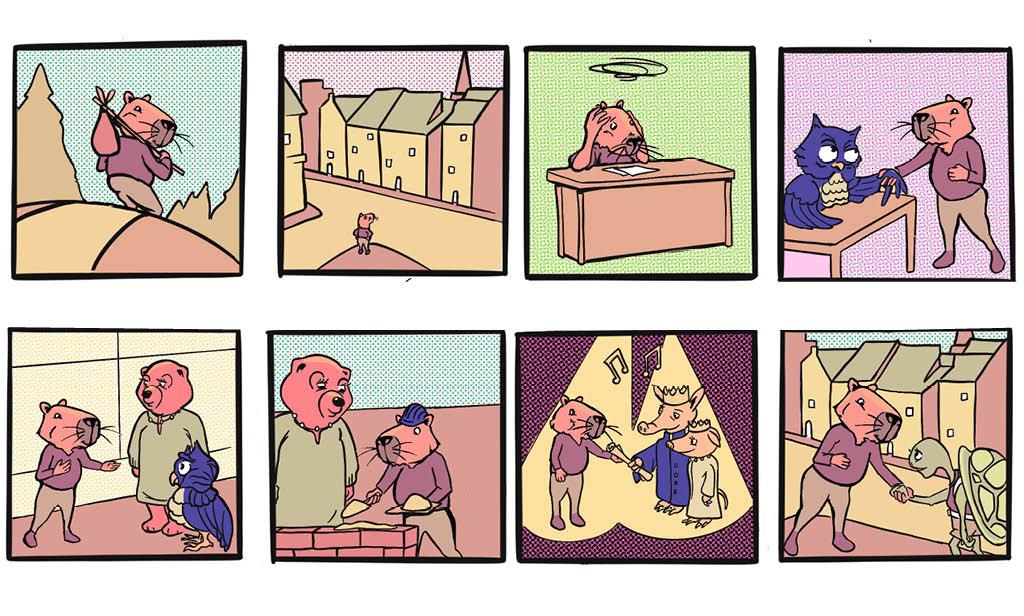

Geïnspireerd door het concept van een Service Blueprint ontwikkelde Waag hiervoor een workshop en een canvas. Een Service Blueprint is een overzicht dat ontwerpers gebruiken om de zichtbare elementen van een proces (ontmoeting bij een loket, voorkant van een website, ontvangen van een brief) in verband te brengen met de verborgen processen ‘aan de achterkant’ (zoals wachtrijsystemen, opvragingen, databases). Zichtbare en verborgen processen zijn altijd samen bepalend voor de ervaring van de gebruiker.

Workshop en canvas zijn vroege prototypes. We zijn benieuwd naar reacties, deze kun je delen met job[@]waag.org.